转自:机器之心

几年前机器之心发布了一个旨在构建 AI 领域术语库的开源项目「Artificial-Intelligence-Terminology-Database」(简称「AITD」)。最近,该项目迎来了第三版。除了常规的更新之外,机器之心还在周志华教授、李航博士、邱锡鹏教授、李沐博士、Aston Zhang 博士等领域专家的指导及帮助下形成了「机器学习」专题篇。未来,机器之心还将会持续完善术语的收录和扩展阅读的构建,另外我们也希望更多 AI 技术社区成员参与到术语库的构建之中,具体的参与方式可以查看文章详情。

2017 年,机器之心发布了第一版人工智能术语库「Artificial-Intelligence-Terminology-Database」(以下简称「AITD」),一个旨在构建 AI 领域专业术语库的开源项目。术语库的前两版主要是将机器之心在编译技术文章和论文过程中所遇到的专业术语记录下来,希望为大家写论文、中文博客、阅读文章提供帮助。此外,读者可以积极指出我们编译的不当之处,以提高我们的专业性。同时,这也是一份开放的表单,希望越来越多的人能够提供增添、修改建议,为人工智能的传播助力,共同推进知识高效、广泛地传播。

2021 年 6 月,《动手学深度学习》的作者李沐博士在与机器之心「AITD」项目团队的交流中提到自己当年在校学习时也曾经因不同的教科书中术语使用标准不一致、中英术语夹杂等问题感到困扰。与此同时,李沐博士提到李航博士正在联合周志华教授、邱锡鹏教授等多位机器学习领域经典教科书作者,希望一起统一下领域术语的翻译,为社区统一专业术语的中文使用提供一个参考。基于这样的一个契机,机器之心「AITD」项目组在周志华教授、李航博士的主持下,邱锡鹏教授、李沐博士、Aston Zhang 博士的指导和帮助下,完成了对多本机器学习领域经典教科书术语中文翻译统一,并发布「AITD」Version 3.0,在 AI 术语库中加入「专项领域」系列。

在与专家讨论的过程中,不同的专家对同一个词的翻译也会有分歧。在这种情况下,专家们会从自身经验、理解出发,帮助其余专家理解自己这样翻译的一个背景知识。经过专家们不断的讨论,对于一个词的翻译最终会接近或达到一个共识。

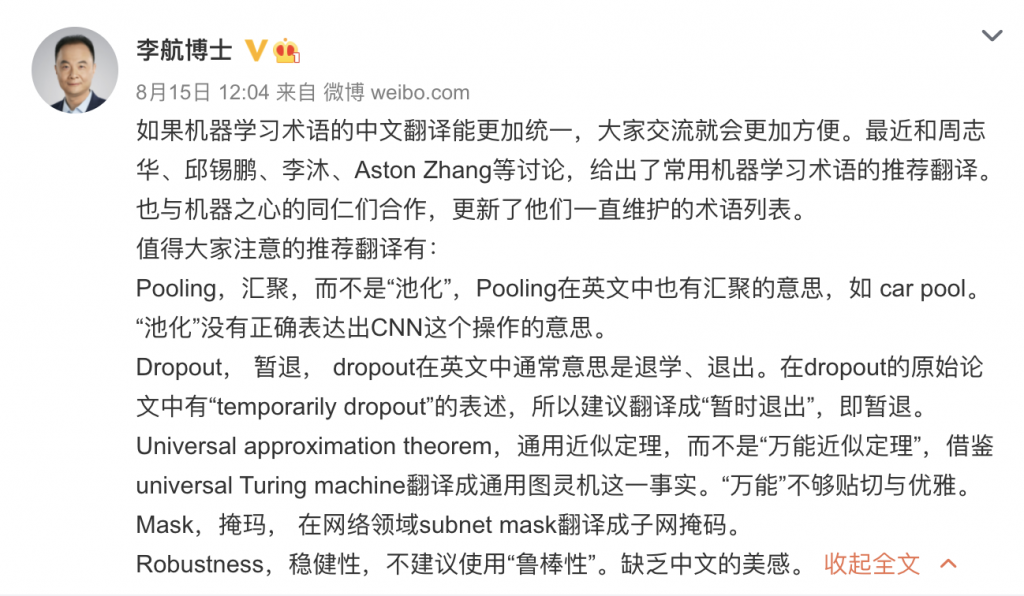

在此过程中,我们也记录了一些有意思的结果。例如 “Robust” 经常会被翻译为“鲁棒性”,专家们认为这个翻译缺少了中文的美感。此外,在控制论中有将 “Robust” 翻译成“强健性的,在经过专家讨论之后,我们将“稳健性”作为“Robust”的推荐翻译;“Dropout”一直没有较好的翻译,几位专家根据 Dropout 原文中的定义,一致认为“暂退法”是比较较为合适的翻译;“Zero/Few/One-shot Learning”一般翻译为“零/少/单样本学习”,但专家们认为“样本”不严谨,因为它并不是真的“零/少/单”样本,而是在建立一个映射之后,再利用少量样本进行迁移。翻译成样本的话,很容易跟学习理论中真正的“小样本学习”混淆了。尤其是“shot”本身并没有“样本”的含义,而是“快照”的含义更接近,于是专家们倾向翻译为“零/少/单试学习”。以下是李航博士微博关于一些推荐翻译介绍的截图。

项目地址:https://github.com/jiqizhixin/Artificial-Intelligence-Terminology-Database

GitBook 地址:https://jiqizhixin.gitbook.io/artificial-intelligence-terminology-database/

划重点:「AITD」Version 3.0「专项领域」机器学习篇完整内容在本文文末收录。

「AITD」Version 3.0 更新了什么?

1、第三版术语库发布,包含了 2094 个术语

「AITD」Version 3.0 相较于第一版的 500 词、第二版的 755 词,在规模上扩大了不少。术语库第三版包含了 2094 个专业术语。

2、增加了领域专题 Section,第一个 Section 为机器学习(Machine Learning)篇,包含了 726 个术语

在周志华教授、李航博士、邱锡鹏教授、李沐博士、Aston Zhang 博士指导和帮助下「AITD」项目团队完成了第一个「专项领域」篇 ——「机器学习」篇,并收录在 Version 3.0 的更新中。在后续的版本更新中,机器之心将搜集自权威教科书、论文等具有公信力的资料源中的术语表进行校验汇总,并从中筛选出一些具有争议、没有翻译等情况的术语给到领域专家进行集中讨论以确认翻译、统一翻译。

3、优化了术语的组织形式,每一个术语都会有如下的字段帮助大家更全面地理解

- 索引编号:考虑到讨论交流、数据库维护的效率,我们将使用「Artificial-Intelligence-Terminology-Database」的缩写 AITD 并加上数字作为术语的编号,根据当前术语库的首字母顺序进行标注,索引编号将从 AITD-00000 开始;

- 英文术语:英文术语;

- 中文翻译:该英文术语目前推荐的中文翻译;

- 常用缩写:该英文术语常用的缩写形式;

- 来源 & 扩展:来源 & 扩展是对该术语的注解,在前两版中的内容为机器之心往期的相关文章。我们希望不仅能提供相对应的术语,同时还希望能为读者提供每一个术语的来源和概念上的扩展。从第三版起,我们将关联更多的资源内容,包括但不限于教科书、论文等来源。但由于这一部分工作量较大,我们将与读者共同推进这一部分扩展的进程,进一步提升术语信度。

- 备注:关于该术语的一些注解。

4、增加了知识共享许可证

本作品将采用知识共享署名 – 非商业性使用 – 相同方式共享 4.0 国际许可协议(CC BY-NC-SA 4.0)进行许可。同时,我们响应了 GitHub 仓库中网友的建议,增加了 GitBook 的链接,方便大家查阅。

「AITD」后续有什么计划?

本项目中所有英文专业术语对照的中文都来自机器之心编译的文章和系列机器学习教科书(如周志华教授的《机器学习》、李航博士的《统计学习方法》、邱锡鹏教授的《神经网络与深度学习》、李沐博士的《动手学深度学习》、李宏毅教授的《机器学习方法》和 Ian Goodfellow 的《深度学习》中译版等),我们力求在提供准确翻译的同时保留最常用的形式。同时,为了保证术语翻译的准确性,我们将此项目向读者开源,并希望能与读者共同迭代术语的准确度。

除了日常编译工作积累之外,我们将逐专项领域基于权威教科书及文献,联合领域专家进一步扩展并完善本仓库,为社区提供具有统一性的 AI 及相关领域的中英术语翻译对照参考。在接下来的一段时间里,机器之心将从三个方面持续完善术语的收录和扩展阅读的构建:

① 继续完善基础术语的构建,即通过权威教科书或其它有公信力的资料抽取常见术语;

② 续性地把编译论文或其他资料中所出现的非常见术语更新到术语库中;

③ 联合更多专项领域专家,构建专项领域术语库。自「AITD」Version 3.0 起,机器之心「AITD」项目团队将基于以下标准开展「专项领域」术语库工作:

1)基于权威教科书、论文等具有公信力的资料源提取词汇。

2)邀请对应领域专家进行专业指导目前 「AITD」Version 3.0 已包含机器学习(Machine Learning)篇,本项目还将逐步更新更多专项领域篇,在此「AITD」项目组邀请各位专项领域专家学者共同参与指导专项领域篇的形成工作,对「AITD」项目感兴趣并希望贡献一部分您的时间支持这个项目的领域专家学者可通过 lab@jiqizhixin.com 联系我们。

致谢!

衷心感谢以下专家参与了包含但不限于术语提供、校对、翻译研讨等工作,为该项目扩展了专项领域术语收录的覆盖度、提升了术语中文翻译用法的准确性、专业性及公信力,感谢老师们的辛勤贡献(排名以 A~Z 进行排序):

1. Aston Zhang 博士,《动手学深度学习》作者

2. 李航博士,《统计学习方法》作者

3. 李沐博士,《动手学深度学习》作者

4. 邱锡鹏教授,《神经网络与深度学习》作者

5. 周志华教授,《机器学习》作者

读者及用户的反馈意见和更新建议将贯穿整个阶段,我们也将在项目致谢页中展示对该项目起积极作用的读者及用户。如果您在使用术语库的过程中若发现了存在的错误、或是想要扩展术语库的内容、讨论特定术语的翻译等等非常欢迎大家提 Issue 与我们以及各位读者进行讨论(请附带来源,以便我们能更客观地更新词汇)。同时也非常欢迎读者们进行 Fork、提 Pull Request,共同加强术语的编译质量以及扩充术语库的规模。

参与「AITD」!

我们邀请更多感兴趣一起参与「AITD」项目的小伙伴通过加入「机器之心分析师网络」加入到「AITD」项目工作中来。除了旨在构建 AI 领域术语库的「Artificial-Intelligence-Terminology-Database」,机器之心目前还有「开放知识库」 GitHub 项目,例如 ——

「ML-Tutorial-Experiment」算法教程与实现项目目前共获得 2400+ Star。它目前有五篇详细的教程文章,即 CNN 的实现、经典 GAN 的推导实现、 CapsNet 的解读、LSTM 等语言建模和基于 Transformer 的神经机器翻译实现。我们希望能提供高质量和能实现的技术文章,在这些文章中,我们所使用的代码块或整体实现都是我们预先测试的,且提供的 Jupyter Notebook 都带有代码注释,非常适合初学者随文章阅读。

项目地址:https://github.com/jiqizhixin/ML-Tutorial-Experiment

「SyncedLeg2018」 机器之腿项目是源于机器之心 2018 年暑期实习生 Hackathon 的输出成果,可基于微信历史文章与相应的流量数据、分析统计出热点词汇。

项目地址:https://github.com/jiqizhixin/SyncedLeg2018

加入机器之心分析师网络,在参与机器之心发起的人工智能及相关技术领域的「开放知识库」项目之外,还将有机会受邀作为特约分析师

- 现场参与国内外学术、学术及产业盛会,现场观察。

- 参与热点技术解读、指标分析、性能评测等专业性技术分析项目。

- 参与热点事件解读、产业前景分析等专业性产业分析项目。

在过去的五年里数百位兼职分析师们利用自己的工作、学习之余的闲暇时间,与机器之心的全职分析师们共同构建 AI 知识库、维护开源项目、撰写技术分析、开展专业调研、联合发布报告等等。参与机器之心全球开放项目的分析师大部分来自于内一流的研究机构及一流人工智能企业,其中包括卡耐基梅隆大学,滑铁卢大学,多伦多大学,加州大学洛杉矶分校,清华大学等等。

「AITD」Version 3.0:「机器学习」专项领域术语中英对照表

| 英文术语 | 中文翻译 |

| 0-1 Loss Function | 0-1损失函数 |

| Accept-Reject Sampling Method | 接受-拒绝抽样法/接受-拒绝采样法 |

| Accumulated Error Backpropagation | 累积误差反向传播 |

| Accuracy | 精度 |

| Acquisition Function | 采集函数 |

| Action | 动作 |

| Activation Function | 激活函数 |

| Active Learning | 主动学习 |

| Adaptive Bitrate Algorithm | 自适应比特率算法 |

| Adaptive Boosting | AdaBoost |

| Adaptive Gradient Algorithm | AdaGrad |

| Adaptive Moment Estimation Algorithm | Adam算法 |

| Adaptive Resonance Theory | 自适应谐振理论 |

| Additive Model | 加性模型 |

| Affinity Matrix | 亲和矩阵 |

| Agent | 智能体 |

| Algorithm | 算法 |

| Alpha-Beta Pruning | α-β修剪法 |

| Anomaly Detection | 异常检测 |

| Approximate Inference | 近似推断 |

| Area Under ROC Curve | AUC |

| Artificial Intelligence | 人工智能 |

| Artificial Neural Network | 人工神经网络 |

| Artificial Neuron | 人工神经元 |

| Attention | 注意力 |

| Attention Mechanism | 注意力机制 |

| Attribute | 属性 |

| Attribute Space | 属性空间 |

| Autoencoder | 自编码器 |

| Automatic Differentiation | 自动微分 |

| Autoregressive Model | 自回归模型 |

| Back Propagation | 反向传播 |

| Back Propagation Algorithm | 反向传播算法 |

| Back Propagation Through Time | 随时间反向传播 |

| Backward Induction | 反向归纳 |

| Backward Search | 反向搜索 |

| Bag of Words | 词袋 |

| Bandit | 赌博机/老虎机 |

| Base Learner | 基学习器 |

| Base Learning Algorithm | 基学习算法 |

| Baseline | 基准 |

| Batch | 批量 |

| Batch Normalization | 批量规范化 |

| Bayes Decision Rule | 贝叶斯决策准则 |

| Bayes Model Averaging | 贝叶斯模型平均 |

| Bayes Optimal Classifier | 贝叶斯最优分类器 |

| Bayes’ Theorem | 贝叶斯定理 |

| Bayesian Decision Theory | 贝叶斯决策理论 |

| Bayesian Inference | 贝叶斯推断 |

| Bayesian Learning | 贝叶斯学习 |

| Bayesian Network | 贝叶斯网/贝叶斯网络 |

| Bayesian Optimization | 贝叶斯优化 |

| Beam Search | 束搜索 |

| Benchmark | 基准 |

| Belief Network | 信念网/信念网络 |

| Belief Propagation | 信念传播 |

| Bellman Equation | 贝尔曼方程 |

| Bernoulli Distribution | 伯努利分布 |

| Beta Distribution | 贝塔分布 |

| Between-Class Scatter Matrix | 类间散度矩阵 |

| BFGS | BFGS |

| Bias | 偏差/偏置 |

| Bias In Affine Function | 偏置 |

| Bias In Statistics | 偏差 |

| Bias Shift | 偏置偏移 |

| Bias-Variance Decomposition | 偏差 – 方差分解 |

| Bias-Variance Dilemma | 偏差 – 方差困境 |

| Bidirectional Recurrent Neural Network | 双向循环神经网络 |

| Bigram | 二元语法 |

| Bilingual Evaluation Understudy | BLEU |

| Binary Classification | 二分类 |

| Binomial Distribution | 二项分布 |

| Binomial Test | 二项检验 |

| Boltzmann Distribution | 玻尔兹曼分布 |

| Boltzmann Machine | 玻尔兹曼机 |

| Boosting | Boosting |

| Bootstrap Aggregating | Bagging |

| Bootstrap Sampling | 自助采样法 |

| Bootstrapping | 自助法/自举法 |

| Break-Event Point | 平衡点 |

| Bucketing | 分桶 |

| Calculus of Variations | 变分法 |

| Cascade-Correlation | 级联相关 |

| Catastrophic Forgetting | 灾难性遗忘 |

| Categorical Distribution | 类别分布 |

| Cell | 单元 |

| Chain Rule | 链式法则 |

| Chebyshev Distance | 切比雪夫距离 |

| Class | 类别 |

| Class-Imbalance | 类别不平衡 |

| Classification | 分类 |

| Classification And Regression Tree | 分类与回归树 |

| Classifier | 分类器 |

| Clique | 团 |

| Cluster | 簇 |

| Cluster Assumption | 聚类假设 |

| Clustering | 聚类 |

| Clustering Ensemble | 聚类集成 |

| Co-Training | 协同训练 |

| Coding Matrix | 编码矩阵 |

| Collaborative Filtering | 协同过滤 |

| Competitive Learning | 竞争型学习 |

| Comprehensibility | 可解释性 |

| Computation Graph | 计算图 |

| Computational Learning Theory | 计算学习理论 |

| Conditional Entropy | 条件熵 |

| Conditional Probability | 条件概率 |

| Conditional Probability Distribution | 条件概率分布 |

| Conditional Random Field | 条件随机场 |

| Conditional Risk | 条件风险 |

| Confidence | 置信度 |

| Confusion Matrix | 混淆矩阵 |

| Conjugate Distribution | 共轭分布 |

| Connection Weight | 连接权 |

| Connectionism | 连接主义 |

| Consistency | 一致性 |

| Constrained Optimization | 约束优化 |

| Context Variable | 上下文变量 |

| Context Vector | 上下文向量 |

| Context Window | 上下文窗口 |

| Context Word | 上下文词 |

| Contextual Bandit | 上下文赌博机/上下文老虎机 |

| Contingency Table | 列联表 |

| Continuous Attribute | 连续属性 |

| Contrastive Divergence | 对比散度 |

| Convergence | 收敛 |

| Convex Optimization | 凸优化 |

| Convex Quadratic Programming | 凸二次规划 |

| Convolution | 卷积 |

| Convolutional Kernel | 卷积核 |

| Convolutional Neural Network | 卷积神经网络 |

| Coordinate Descent | 坐标下降 |

| Corpus | 语料库 |

| Correlation Coefficient | 相关系数 |

| Cosine Similarity | 余弦相似度 |

| Cost | 代价 |

| Cost Curve | 代价曲线 |

| Cost Function | 代价函数 |

| Cost Matrix | 代价矩阵 |

| Cost-Sensitive | 代价敏感 |

| Covariance | 协方差 |

| Covariance Matrix | 协方差矩阵 |

| Critical Point | 临界点 |

| Cross Entropy | 交叉熵 |

| Cross Validation | 交叉验证 |

| Curse of Dimensionality | 维数灾难 |

| Cutting Plane Algorithm | 割平面法 |

| Data Mining | 数据挖掘 |

| Data Set | 数据集 |

| Davidon-Fletcher-Powell | DFP |

| Decision Boundary | 决策边界 |

| Decision Function | 决策函数 |

| Decision Stump | 决策树桩 |

| Decision Tree | 决策树 |

| Decoder | 解码器 |

| Decoding | 解码 |

| Deconvolution | 反卷积 |

| Deconvolutional Network | 反卷积网络 |

| Deduction | 演绎 |

| Deep Belief Network | 深度信念网络 |

| Deep Boltzmann Machine | 深度玻尔兹曼机 |

| Deep Convolutional Generative Adversarial Network | 深度卷积生成对抗网络 |

| Deep Learning | 深度学习 |

| Deep Neural Network | 深度神经网络 |

| Deep Q-Network | 深度Q网络 |

| Delta-Bar-Delta | Delta-Bar-Delta |

| Denoising | 去噪 |

| Denoising Autoencoder | 去噪自编码器 |

| Denoising Score Matching | 去躁分数匹配 |

| Density Estimation | 密度估计 |

| Density-Based Clustering | 密度聚类 |

| Derivative | 导数 |

| Determinant | 行列式 |

| Diagonal Matrix | 对角矩阵 |

| Dictionary Learning | 字典学习 |

| Dimension Reduction | 降维 |

| Directed Edge | 有向边 |

| Directed Graphical Model | 有向图模型 |

| Directed Separation | 有向分离 |

| Dirichlet Distribution | 狄利克雷分布 |

| Discriminative Model | 判别式模型 |

| Discriminator | 判别器 |

| Discriminator Network | 判别网络 |

| Distance Measure | 距离度量 |

| Distance Metric Learning | 距离度量学习 |

| Distributed Representation | 分布式表示 |

| Diverge | 发散 |

| Divergence | 散度 |

| Diversity | 多样性 |

| Diversity Measure | 多样性度量/差异性度量 |

| Domain Adaptation | 领域自适应 |

| Dominant Strategy | 主特征值 |

| Dominant Strategy | 占优策略 |

| Down Sampling | 下采样 |

| Dropout | 暂退法 |

| Dropout Boosting | 暂退Boosting |

| Dropout Method | 暂退法 |

| Dual Problem | 对偶问题 |

| Dummy Node | 哑结点 |

| Dynamic Bayesian Network | 动态贝叶斯网络 |

| Dynamic Programming | 动态规划 |

| Early Stopping | 早停 |

| Eigendecomposition | 特征分解 |

| Eigenvalue | 特征值 |

| Element-Wise Product | 逐元素积 |

| Embedding | 嵌入 |

| Empirical Conditional Entropy | 经验条件熵 |

| Empirical Distribution | 经验分布 |

| Empirical Entropy | 经验熵 |

| Empirical Error | 经验误差 |

| Empirical Risk | 经验风险 |

| Empirical Risk Minimization | 经验风险最小化 |

| Encoder | 编码器 |

| Encoding | 编码 |

| End-To-End | 端到端 |

| Energy Function | 能量函数 |

| Energy-Based Model | 基于能量的模型 |

| Ensemble Learning | 集成学习 |

| Ensemble Pruning | 集成修剪 |

| Entropy | 熵 |

| Episode | 回合 |

| Epoch | 轮 |

| Error | 误差 |

| Error Backpropagation Algorithm | 误差反向传播算法 |

| Error Backpropagation | 误差反向传播 |

| Error Correcting Output Codes | 纠错输出编码 |

| Error Rate | 错误率 |

| Error-Ambiguity Decomposition | 误差-分歧分解 |

| Estimator | 估计/估计量 |

| Euclidean Distance | 欧氏距离 |

| Evidence | 证据 |

| Evidence Lower Bound | 证据下界 |

| Exact Inference | 精确推断 |

| Example | 样例 |

| Expectation | 期望 |

| Expectation Maximization | 期望最大化 |

| Expected Loss | 期望损失 |

| Expert System | 专家系统 |

| Exploding Gradient | 梯度爆炸 |

| Exponential Loss Function | 指数损失函数 |

| Factor | 因子 |

| Factorization | 因子分解 |

| Feature | 特征 |

| Feature Engineering | 特征工程 |

| Feature Map | 特征图 |

| Feature Selection | 特征选择 |

| Feature Vector | 特征向量 |

| Featured Learning | 特征学习 |

| Feedforward | 前馈 |

| Feedforward Neural Network | 前馈神经网络 |

| Few-Shot Learning | 少试学习 |

| Filter | 滤波器 |

| Fine-Tuning | 微调 |

| Fluctuation | 振荡 |

| Forget Gate | 遗忘门 |

| Forward Propagation | 前向传播/正向传播 |

| Forward Stagewise Algorithm | 前向分步算法 |

| Fractionally Strided Convolution | 微步卷积 |

| Frobenius Norm | Frobenius 范数 |

| Full Padding | 全填充 |

| Functional | 泛函 |

| Functional Neuron | 功能神经元 |

| Gated Recurrent Unit | 门控循环单元 |

| Gated RNN | 门控RNN |

| Gaussian Distribution | 高斯分布 |

| Gaussian Kernel | 高斯核 |

| Gaussian Kernel Function | 高斯核函数 |

| Gaussian Mixture Model | 高斯混合模型 |

| Gaussian Process | 高斯过程 |

| Generalization Ability | 泛化能力 |

| Generalization Error | 泛化误差 |

| Generalization Error Bound | 泛化误差上界 |

| Generalize | 泛化 |

| Generalized Lagrange Function | 广义拉格朗日函数 |

| Generalized Linear Model | 广义线性模型 |

| Generalized Rayleigh Quotient | 广义瑞利商 |

| Generative Adversarial Network | 生成对抗网络 |

| Generative Model | 生成式模型 |

| Generator | 生成器 |

| Generator Network | 生成器网络 |

| Genetic Algorithm | 遗传算法 |

| Gibbs Distribution | 吉布斯分布 |

| Gibbs Sampling | 吉布斯采样/吉布斯抽样 |

| Gini Index | 基尼指数 |

| Global Markov Property | 全局马尔可夫性 |

| Global Minimum | 全局最小 |

| Gradient | 梯度 |

| Gradient Clipping | 梯度截断 |

| Gradient Descent | 梯度下降 |

| Gradient Descent Method | 梯度下降法 |

| Gradient Exploding Problem | 梯度爆炸问题 |

| Gram Matrix | Gram 矩阵 |

| Graph Convolutional Network | 图卷积神经网络/图卷积网络 |

| Graph Neural Network | 图神经网络 |

| Graphical Model | 图模型 |

| Grid Search | 网格搜索 |

| Ground Truth | 真实值 |

| Hadamard Product | Hadamard积 |

| Hamming Distance | 汉明距离 |

| Hard Margin | 硬间隔 |

| Hebbian Rule | 赫布法则 |

| Hidden Layer | 隐藏层 |

| Hidden Markov Model | 隐马尔可夫模型 |

| Hidden Variable | 隐变量 |

| Hierarchical Clustering | 层次聚类 |

| Hilbert Space | 希尔伯特空间 |

| Hinge Loss Function | 合页损失函数/Hinge损失函数 |

| Hold-Out | 留出法 |

| Hyperparameter | 超参数 |

| Hyperparameter Optimization | 超参数优化 |

| Hypothesis | 假设 |

| Hypothesis Space | 假设空间 |

| Hypothesis Test | 假设检验 |

| Identity Matrix | 单位矩阵 |

| Imitation Learning | 模仿学习 |

| Importance Sampling | 重要性采样 |

| Improved Iterative Scaling | 改进的迭代尺度法 |

| Incremental Learning | 增量学习 |

| Independent and Identically Distributed | 独立同分布 |

| Indicator Function | 指示函数 |

| Individual Learner | 个体学习器 |

| Induction | 归纳 |

| Inductive Bias | 归纳偏好 |

| Inductive Learning | 归纳学习 |

| Inductive Logic Programming | 归纳逻辑程序设计 |

| Inference | 推断 |

| Information Entropy | 信息熵 |

| Information Gain | 信息增益 |

| Inner Product | 内积 |

| Instance | 示例 |

| Internal Covariate Shift | 内部协变量偏移 |

| Inverse Matrix | 逆矩阵 |

| Inverse Resolution | 逆归结 |

| Isometric Mapping | 等度量映射 |

| Jacobian Matrix | 雅可比矩阵 |

| Jensen Inequality | Jensen不等式 |

| Joint Probability Distribution | 联合概率分布 |

| K-Armed Bandit Problem | k-摇臂老虎机 |

| K-Fold Cross Validation | k 折交叉验证 |

| Karush-Kuhn-Tucker Condition | KKT条件 |

| Karush–Kuhn–Tucker | Karush–Kuhn–Tucker |

| Kernel Function | 核函数 |

| Kernel Method | 核方法 |

| Kernel Trick | 核技巧 |

| Kernelized Linear Discriminant Analysis | 核线性判别分析 |

| KL Divergence | KL散度 |

| L-BFGS | L-BFGS |

| Label | 标签 |

| Label Space | 标记空间 |

| Lagrange Duality | 拉格朗日对偶性 |

| Lagrange Multiplier | 拉格朗日乘子 |

| Language Model | 语言模型 |

| Laplace Smoothing | 拉普拉斯平滑 |

| Laplacian Correction | 拉普拉斯修正 |

| Latent Dirichlet Allocation | 潜在狄利克雷分配 |

| Latent Semantic Analysis | 潜在语义分析 |

| Latent Variable | 潜变量/隐变量 |

| Law of Large Numbers | 大数定律 |

| Layer Normalization | 层规范化 |

| Lazy Learning | 懒惰学习 |

| Leaky Relu | 泄漏修正线性单元/泄漏整流线性单元 |

| Learner | 学习器 |

| Learning | 学习 |

| Learning By Analogy | 类比学习 |

| Learning Rate | 学习率 |

| Learning Vector Quantization | 学习向量量化 |

| Least Square Method | 最小二乘法 |

| Least Squares Regression Tree | 最小二乘回归树 |

| Left Singular Vector | 左奇异向量 |

| Likelihood | 似然 |

| Linear Chain Conditional Random Field | 线性链条件随机场 |

| Linear Classification Model | 线性分类模型 |

| Linear Classifier | 线性分类器 |

| Linear Dependence | 线性相关 |

| Linear Discriminant Analysis | 线性判别分析 |

| Linear Model | 线性模型 |

| Linear Regression | 线性回归 |

| Link Function | 联系函数 |

| Local Markov Property | 局部马尔可夫性 |

| Local Minima | 局部极小 |

| Local Minimum | 局部极小 |

| Local Representation | 局部式表示/局部式表征 |

| Log Likelihood | 对数似然函数 |

| Log Linear Model | 对数线性模型 |

| Log-Likelihood | 对数似然 |

| Log-Linear Regression | 对数线性回归 |

| Logistic Function | 对数几率函数 |

| Logistic Regression | 对数几率回归 |

| Logit | 对数几率 |

| Long Short Term Memory | 长短期记忆 |

| Long Short-Term Memory Network | 长短期记忆网络 |

| Loopy Belief Propagation | 环状信念传播 |

| Loss Function | 损失函数 |

| Low Rank Matrix Approximation | 低秩矩阵近似 |

| Machine Learning | 机器学习 |

| Macron-R | 宏查全率 |

| Manhattan Distance | 曼哈顿距离 |

| Manifold | 流形 |

| Manifold Assumption | 流形假设 |

| Manifold Learning | 流形学习 |

| Margin | 间隔 |

| Marginal Distribution | 边缘分布 |

| Marginal Independence | 边缘独立性 |

| Marginalization | 边缘化 |

| Markov Chain | 马尔可夫链 |

| Markov Chain Monte Carlo | 马尔可夫链蒙特卡罗 |

| Markov Decision Process | 马尔可夫决策过程 |

| Markov Network | 马尔可夫网络 |

| Markov Process | 马尔可夫过程 |

| Markov Random Field | 马尔可夫随机场 |

| Mask | 掩码 |

| Matrix | 矩阵 |

| Matrix Inversion | 逆矩阵 |

| Max Pooling | 最大汇聚 |

| Maximal Clique | 最大团 |

| Maximum Entropy Model | 最大熵模型 |

| Maximum Likelihood Estimation | 极大似然估计 |

| Maximum Margin | 最大间隔 |

| Mean Filed | 平均场 |

| Mean Pooling | 平均汇聚 |

| Mean Squared Error | 均方误差 |

| Mean-Field | 平均场 |

| Memory Network | 记忆网络 |

| Message Passing | 消息传递 |

| Metric Learning | 度量学习 |

| Micro-R | 微查全率 |

| Minibatch | 小批量 |

| Minimal Description Length | 最小描述长度 |

| Minimax Game | 极小极大博弈 |

| Minkowski Distance | 闵可夫斯基距离 |

| Mixture of Experts | 混合专家模型 |

| Mixture-of-Gaussian | 高斯混合 |

| Model | 模型 |

| Model Selection | 模型选择 |

| Momentum Method | 动量法 |

| Monte Carlo Method | 蒙特卡罗方法 |

| Moral Graph | 端正图/道德图 |

| Moralization | 道德化 |

| Multi-Class Classification | 多分类 |

| Multi-Head Attention | 多头注意力 |

| Multi-Head Self-Attention | 多头自注意力 |

| Multi-Kernel Learning | 多核学习 |

| Multi-Label Learning | 多标记学习 |

| Multi-Layer Feedforward Neural Networks | 多层前馈神经网络 |

| Multi-Layer Perceptron | 多层感知机 |

| Multinomial Distribution | 多项分布 |

| Multiple Dimensional Scaling | 多维缩放 |

| Multiple Linear Regression | 多元线性回归 |

| Multitask Learning | 多任务学习 |

| Multivariate Normal Distribution | 多元正态分布 |

| Mutual Information | 互信息 |

| N-Gram Model | N元模型 |

| Naive Bayes Classifier | 朴素贝叶斯分类器 |

| Naive Bayes | 朴素贝叶斯 |

| Nearest Neighbor Classifier | 最近邻分类器 |

| Negative Log Likelihood | 负对数似然函数 |

| Neighbourhood Component Analysis | 近邻成分分析 |

| Net Input | 净输入 |

| Neural Network | 神经网络 |

| Neural Turing Machine | 神经图灵机 |

| Neuron | 神经元 |

| Newton Method | 牛顿法 |

| No Free Lunch Theorem | 没有免费午餐定理 |

| Noise-Contrastive Estimation | 噪声对比估计 |

| Nominal Attribute | 列名属性 |

| Non-Convex Optimization | 非凸优化 |

| Non-Metric Distance | 非度量距离 |

| Non-Negative Matrix Factorization | 非负矩阵分解 |

| Non-Ordinal Attribute | 无序属性 |

| Norm | 范数 |

| Normal Distribution | 正态分布 |

| Normalization | 规范化 |

| Nuclear Norm | 核范数 |

| Number of Epochs | 轮数 |

| Numerical Attribute | 数值属性 |

| Object Detection | 目标检测 |

| Oblique Decision Tree | 斜决策树 |

| Occam’s Razor | 奥卡姆剃刀 |

| Odds | 几率 |

| Off-Policy | 异策略 |

| On-Policy | 同策略 |

| One-Dependent Estimator | 独依赖估计 |

| One-Hot | 独热 |

| Online Learning | 在线学习 |

| Optimizer | 优化器 |

| Ordinal Attribute | 有序属性 |

| Orthogonal | 正交 |

| Orthogonal Matrix | 正交矩阵 |

| Out-Of-Bag Estimate | 包外估计 |

| Outlier | 异常点 |

| Over-Parameterized | 过度参数化 |

| Overfitting | 过拟合 |

| Oversampling | 过采样 |

| Pac-Learnable | PAC可学习 |

| Padding | 填充 |

| Pairwise Markov Property | 成对马尔可夫性 |

| Parallel Distributed Processing | 分布式并行处理 |

| Parameter | 参数 |

| Parameter Estimation | 参数估计 |

| Parameter Space | 参数空间 |

| Parameter Tuning | 调参 |

| Parametric ReLU | 参数化修正线性单元/参数化整流线性单元 |

| Part-Of-Speech Tagging | 词性标注 |

| Partial Derivative | 偏导数 |

| Partially Observable Markov Decision Processes | 部分可观测马尔可夫决策过程 |

| Partition Function | 配分函数 |

| Perceptron | 感知机 |

| Performance Measure | 性能度量 |

| Perplexity | 困惑度 |

| Pointer Network | 指针网络 |

| Policy | 策略 |

| Policy Gradient | 策略梯度 |

| Policy Iteration | 策略迭代 |

| Polynomial Kernel Function | 多项式核函数 |

| Pooling | 汇聚 |

| Pooling Layer | 汇聚层 |

| Positive Definite Matrix | 正定矩阵 |

| Post-Pruning | 后剪枝 |

| Potential Function | 势函数 |

| Power Method | 幂法 |

| Pre-Training | 预训练 |

| Precision | 查准率/准确率 |

| Prepruning | 预剪枝 |

| Primal Problem | 主问题 |

| Primary Visual Cortex | 初级视觉皮层 |

| Principal Component Analysis | 主成分分析 |

| Prior | 先验 |

| Probabilistic Context-Free Grammar | 概率上下文无关文法 |

| Probabilistic Graphical Model | 概率图模型 |

| Probabilistic Model | 概率模型 |

| Probability Density Function | 概率密度函数 |

| Probability Distribution | 概率分布 |

| Probably Approximately Correct | 概率近似正确 |

| Proposal Distribution | 提议分布 |

| Prototype-Based Clustering | 原型聚类 |

| Proximal Gradient Descent | 近端梯度下降 |

| Pruning | 剪枝 |

| Quadratic Loss Function | 平方损失函数 |

| Quadratic Programming | 二次规划 |

| Quasi Newton Method | 拟牛顿法 |

| Radial Basis Function | 径向基函数 |

| Random Forest | 随机森林 |

| Random Sampling | 随机采样 |

| Random Search | 随机搜索 |

| Random Variable | 随机变量 |

| Random Walk | 随机游走 |

| Recall | 查全率/召回率 |

| Receptive Field | 感受野 |

| Reconstruction Error | 重构误差 |

| Rectified Linear Unit | 修正线性单元/整流线性单元 |

| Recurrent Neural Network | 循环神经网络 |

| Recursive Neural Network | 递归神经网络 |

| Regression | 回归 |

| Regularization | 正则化 |

| Regularizer | 正则化项 |

| Reinforcement Learning | 强化学习 |

| Relative Entropy | 相对熵 |

| Reparameterization | 再参数化/重参数化 |

| Representation | 表示 |

| Representation Learning | 表示学习 |

| Representer Theorem | 表示定理 |

| Reproducing Kernel Hilbert Space | 再生核希尔伯特空间 |

| Rescaling | 再缩放 |

| Reset Gate | 重置门 |

| Residual Connection | 残差连接 |

| Residual Network | 残差网络 |

| Restricted Boltzmann Machine | 受限玻尔兹曼机 |

| Reward | 奖励 |

| Ridge Regression | 岭回归 |

| Right Singular Vector | 右奇异向量 |

| Risk | 风险 |

| Robustness | 稳健性 |

| Root Node | 根结点 |

| Rule Learning | 规则学习 |

| Saddle Point | 鞍点 |

| Sample | 样本 |

| Sample Complexity | 样本复杂度 |

| Sample Space | 样本空间 |

| Scalar | 标量 |

| Selective Ensemble | 选择性集成 |

| Self Information | 自信息 |

| Self-Attention | 自注意力 |

| Self-Organizing Map | 自组织映射网 |

| Self-Training | 自训练 |

| Semi-Definite Programming | 半正定规划 |

| Semi-Naive Bayes Classifiers | 半朴素贝叶斯分类器 |

| Semi-Restricted Boltzmann Machine | 半受限玻尔兹曼机 |

| Semi-Supervised Clustering | 半监督聚类 |

| Semi-Supervised Learning | 半监督学习 |

| Semi-Supervised Support Vector Machine | 半监督支持向量机 |

| Sentiment Analysis | 情感分析 |

| Separating Hyperplane | 分离超平面 |

| Sequential Covering | 序贯覆盖 |

| Sigmoid Belief Network | Sigmoid信念网络 |

| Sigmoid Function | Sigmoid函数 |

| Signed Distance | 带符号距离 |

| Similarity Measure | 相似度度量 |

| Simulated Annealing | 模拟退火 |

| Simultaneous Localization And Mapping | 即时定位与地图构建 |

| Singular Value | 奇异值 |

| Singular Value Decomposition | 奇异值分解 |

| Skip-Gram Model | 跳元模型 |

| Smoothing | 平滑 |

| Soft Margin | 软间隔 |

| Soft Margin Maximization | 软间隔最大化 |

| Softmax | Softmax/软最大化 |

| Softmax Function | Softmax函数/软最大化函数 |

| Softmax Regression | Softmax回归/软最大化回归 |

| Softplus Function | Softplus函数 |

| Span | 张成子空间 |

| Sparse Coding | 稀疏编码 |

| Sparse Representation | 稀疏表示 |

| Sparsity | 稀疏性 |

| Specialization | 特化 |

| Splitting Variable | 切分变量 |

| Squashing Function | 挤压函数 |

| Standard Normal Distribution | 标准正态分布 |

| State | 状态 |

| State Value Function | 状态值函数 |

| State-Action Value Function | 状态-动作值函数 |

| Stationary Distribution | 平稳分布 |

| Stationary Point | 驻点 |

| Statistical Learning | 统计学习 |

| Steepest Descent | 最速下降法 |

| Stochastic Gradient Descent | 随机梯度下降 |

| Stochastic Matrix | 随机矩阵 |

| Stochastic Process | 随机过程 |

| Stratified Sampling | 分层采样 |

| Stride | 步幅 |

| Structural Risk | 结构风险 |

| Structural Risk Minimization | 结构风险最小化 |

| Subsample | 子采样 |

| Subsampling | 下采样 |

| Subset Search | 子集搜索 |

| Subspace | 子空间 |

| Supervised Learning | 监督学习 |

| Support Vector | 支持向量 |

| Support Vector Expansion | 支持向量展式 |

| Support Vector Machine | 支持向量机 |

| Surrogat Loss | 替代损失 |

| Surrogate Function | 替代函数 |

| Surrogate Loss Function | 代理损失函数 |

| Symbolism | 符号主义 |

| Tangent Propagation | 正切传播 |

| Teacher Forcing | 强制教学 |

| Temporal-Difference Learning | 时序差分学习 |

| Tensor | 张量 |

| Test Error | 测试误差 |

| Test Sample | 测试样本 |

| Test Set | 测试集 |

| Threshold | 阈值 |

| Threshold Logic Unit | 阈值逻辑单元 |

| Threshold-Moving | 阈值移动 |

| Tied Weight | 捆绑权重 |

| Tikhonov Regularization | Tikhonov正则化 |

| Time Delay Neural Network | 时延神经网络 |

| Time Homogenous Markov Chain | 时间齐次马尔可夫链 |

| Time Step | 时间步 |

| Token | 词元 |

| Token | 词元 |

| Tokenization | 词元化 |

| Tokenizer | 词元分析器 |

| Topic Model | 话题模型 |

| Topic Modeling | 话题分析 |

| Trace | 迹 |

| Training | 训练 |

| Training Error | 训练误差 |

| Training Sample | 训练样本 |

| Training Set | 训练集 |

| Transductive Learning | 直推学习 |

| Transductive Transfer Learning | 直推迁移学习 |

| Transfer Learning | 迁移学习 |

| Transformer | Transformer |

| Transformer Model | Transformer模型 |

| Transpose | 转置 |

| Transposed Convolution | 转置卷积 |

| Trial And Error | 试错 |

| Trigram | 三元语法 |

| Turing Machine | 图灵机 |

| Underfitting | 欠拟合 |

| Undersampling | 欠采样 |

| Undirected Graphical Model | 无向图模型 |

| Uniform Distribution | 均匀分布 |

| Unigram | 一元语法 |

| Unit | 单元 |

| Universal Approximation Theorem | 通用近似定理 |

| Universal Approximator | 通用近似器 |

| Universal Function Approximator | 通用函数近似器 |

| Unknown Token | 未知词元 |

| Unsupervised Layer-Wise Training | 无监督逐层训练 |

| Unsupervised Learning | 无监督学习 |

| Update Gate | 更新门 |

| Upsampling | 上采样 |

| V-Structure | V型结构 |

| Validation Set | 验证集 |

| Validity Index | 有效性指标 |

| Value Function Approximation | 值函数近似 |

| Value Iteration | 值迭代 |

| Vanishing Gradient Problem | 梯度消失问题 |

| Vapnik-Chervonenkis Dimension | VC维 |

| Variable Elimination | 变量消去 |

| Variance | 方差 |

| Variational Autoencoder | 变分自编码器 |

| Variational Inference | 变分推断 |

| Vector | 向量 |

| Vector Space Model | 向量空间模型 |

| Version Space | 版本空间 |

| Viterbi Algorithm | 维特比算法 |

| Vocabulary | 词表 |

| Warp | 线程束 |

| Weak Learner | 弱学习器 |

| Weakly Supervised Learning | 弱监督学习 |

| Weight | 权重 |

| Weight Decay | 权重衰减 |

| Weight Sharing | 权共享 |

| Weighted Voting | 加权投票 |

| Whitening | 白化 |

| Winner-Take-All | 胜者通吃 |

| Within-Class Scatter Matrix | 类内散度矩阵 |

| Word Embedding | 词嵌入 |

| Word Sense Disambiguation | 词义消歧 |

| Word Vector | 词向量 |

| Zero Padding | 零填充 |

| Zero-Shot Learning | 零试学习 |

| Zipf’s Law | 齐普夫定律 |

关注微信公众号

关注微信公众号